İşlerin aniden “sadece işe yaraması” her zaman şaşırtıcıdır. 2009’da Wolfram|Alpha ile başımıza geldi. 2020’de Fizik Projemizde oldu. Ve şimdi OpenAI ChatGPT ile oluyor.

Uzun zamandır sinir ağı teknolojisini takip ediyorum (aslında yaklaşık 43 yıldır). Son birkaç yıldaki gelişmeleri izlemiş olmama rağmen ChatGPT’nin performansını tamamen dikkate değer buluyorum. Son olarak ve birdenbire, neredeyse her şey hakkında başarılı bir şekilde metin üretebilen bir sistem ortaya çıktı; bu, insanların yazabileceği metinlere çok benzer. Etkileyici ve kullanışlı. Ve başka bir yerde tartışacağım gibi, başarısının muhtemelen bize insan düşüncesinin doğası hakkında bazı çok temel şeyler söylediğini düşünüyorum.

Ancak ChatGPT, insan benzeri önemli şeylerin yapılmasını otomatikleştirmede dikkate değer bir başarı olsa da, yapılması yararlı olan her şey o kadar “insan benzeri” değildir. Bazıları bunun yerine daha resmi ve yapılandırılmıştır. Ve gerçekten de uygarlığımızın son birkaç yüzyıldaki en büyük başarılarından biri, matematiğin paradigmalarını, kesin bilimleri – ve en önemlisi şimdi hesaplamayı – inşa etmek ve saf insandan oldukça farklı bir yetenekler kulesi yaratmak olmuştur. -gibi düşünme başarabilir.

Ancak ChatGPT, insan benzeri önemli şeylerin yapılmasını otomatikleştirmede dikkate değer bir başarı olsa da, yapılması yararlı olan her şey o kadar “insan benzeri” değildir. Bazıları bunun yerine daha resmi ve yapılandırılmıştır. Ve gerçekten de uygarlığımızın son birkaç yüzyıldaki en büyük başarılarından biri, matematiğin paradigmalarını, kesin bilimleri – ve en önemlisi şimdi hesaplamayı – inşa etmek ve saf insandan oldukça farklı bir yetenekler kulesi yaratmak olmuştur. -gibi düşünme başarabilir.

Ben kendim, dünyadaki mümkün olduğu kadar çok şeyi resmi sembolik yollarla temsil etmek için bir hesaplama dili oluşturmanın tekil arayışı içinde, onlarca yıldır hesaplama paradigmasıyla derinden ilgileniyorum. Ve bunu yaparken amacım, benim ve diğerlerinin yapmak istediklerine “hesaplamalı olarak yardımcı olabilecek” – ve artırabilecek – bir sistem oluşturmaktı. Bir insan olarak bazı şeyleri düşünüyorum. Ama aynı zamanda Wolfram Language ve Wolfram|Alpha’yı, her türlü insan ötesi şeyi yapmama izin veren bir tür benzersiz “hesaplamalı süper güç”ten yararlanmaya çağırabilirim.

Muazzam derecede güçlü bir çalışma şeklidir. Ve mesele şu ki, bu sadece biz insanlar için önemli değil. İnsan benzeri yapay zekalar için de aynı derecede, hatta daha fazla önemlidir – onlara, yapılandırılmış hesaplamanın ve yapılandırılmış bilginin insan benzeri olmayan gücünden yararlanan, hesaplamalı bilgi süper güçleri olarak düşünebileceğimiz şeyi hemen vermek.

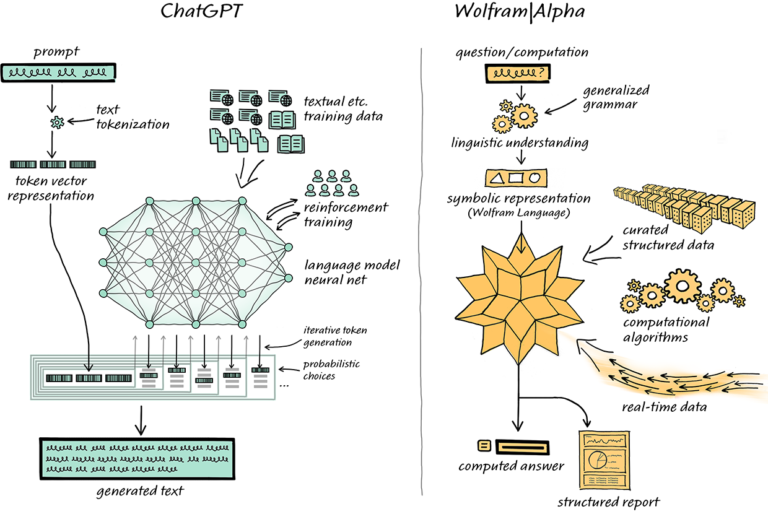

Bunun ChatGPT için ne anlama geldiğini keşfetmeye yeni başladık. Ancak harika şeylerin mümkün olduğu oldukça açık. Wolfram|Alpha, ChatGPT’den çok farklı bir şey yapar, çok farklı bir şekilde. Ancak ortak bir arayüzleri var: doğal dil. Bu da, ChatGPT’nin Wolfram|Alpha ile tıpkı insanların yaptığı gibi “konuşabileceği” anlamına gelir; Wolfram|Alpha, ChatGPT’den aldığı doğal dili, hesaplamalı bilgi gücünü uygulayabileceği kesin, sembolik hesaplamalı dile dönüştürür.

ChatGPT’nin kullandığı türde “istatistiksel yaklaşımlar” ile Wolfram|Alpha’nın fiilen başlangıç noktası olan “sembolik yaklaşımlar” arasında yapay zekayı düşünürken onlarca yıldır bir ikilem vardı. Ancak şimdi – ChatGPT’nin başarısı ve Wolfram|Alpha’nın doğal dili anlamasını sağlamak için yaptığımız tüm çalışmalar sayesinde – sonunda bunları bir araya getirerek her ikisinin de kendi başlarına başaramayacaklarından çok daha güçlü bir şey yapma fırsatına sahibiz.

Basit Bir Örnek

ChatGPT özünde, web’de ve eğitiminde kullanılan kitaplarda ve diğer materyallerde bulunanların “örgüsünü izleyen” dilsel çıktı üretmeye yönelik bir sistemdir. Ve dikkat çekici olan şey, çıktının yalnızca küçük ölçekte değil, tüm makalelerde ne kadar insan benzeri olduğu. Söyleyecek tutarlı şeyleri vardır, öğrendiği kavramları çoğu zaman ilginç ve beklenmedik şekillerde çeker. Ürettiği şey, en azından dilsel düzeyde, her zaman “istatistiksel olarak akla yatkındır”. Ancak -sonunda etkileyici olsa da- bu kesinlikle, kendinden emin bir şekilde öne sürdüğü tüm gerçeklerin ve hesaplamaların mutlaka doğru olduğu anlamına gelmez.

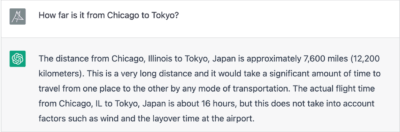

İşte az önce fark ettiğim bir örnek (ve evet, ChatGPT’nin yerleşik rastgeleliği var, bu yüzden bunu denerseniz muhtemelen aynı sonucu alamayacaksınız):

Kulağa oldukça inandırıcı geliyor. Ancak Wolfram|Alpha’nın bize söyleyebileceği gibi, bunun yanlış olduğu ortaya çıktı:

Adil olmak gerekirse, elbette, bu tam olarak Wolfram|Alpha’nın iyi olduğu türden bir şey: yapılandırılmış, derlenmiş bilgisi temelinde yapılabilecek kesin bir hesaplamaya dönüştürülebilen bir şey.

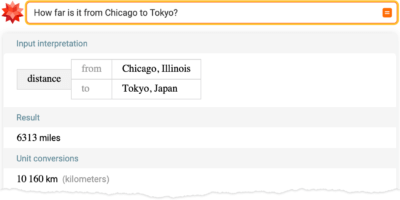

Ancak güzel olan şey, Wolfram|Alpha’nın bu konuda ChatGPT’ye otomatik olarak yardım etmesi düşünülebilir. Wolfram|Alpha’ya programlı olarak şu soru sorulabilir (ayrıca bir web API vb. kullanabilirsiniz):

![]()

Şimdi soruyu ChatGPT’ye tekrar sorun ve bu sonucu ekleyin:

ChatGPT düzeltmeyi çok kibar bir şekilde alır ve soruyu tekrar sorarsanız doğru yanıtı verir. Açıkçası, Wolfram|Alpha ile gidip gelmenin daha modern bir yolu olabilir, ancak bu çok basit saf doğal dil yaklaşımının bile temelde zaten işe yaradığını görmek güzel.

Ancak ChatGPT neden bu özel şeyi en başta yanlış anlıyor? Eğitiminin bir yerinde (örneğin web’den) Chicago ve Tokyo arasındaki belirli mesafeyi görmüş olsaydı, elbette doğru anlayabilirdi. Ancak bu, bir sinir ağının kolayca yapabileceği türden bir genellemenin – örneğin şehirler arasındaki mesafelere ilişkin birçok örnekten – yeterli olmayacağı bir durumdur; gereken gerçek bir hesaplama algoritması var.

Yazının orjinaline Stephen Wolfram’ın kişisel blogundan ulaşabilirsiniz. Linkini buraya bırakıyorum.